ITCOW牛新网 3月9日消息,微软近日对其视觉设计应用Microsoft Designer进行了调整,以应对在使用特定提示词时AI生成不适当图像的问题。Microsoft Designer是一款基于Copilot和DALLE 3.0技术的工具,能够根据用户提供的简单提示词生成所需图像,同时还提供去背景、生成个性化贴纸等功能。

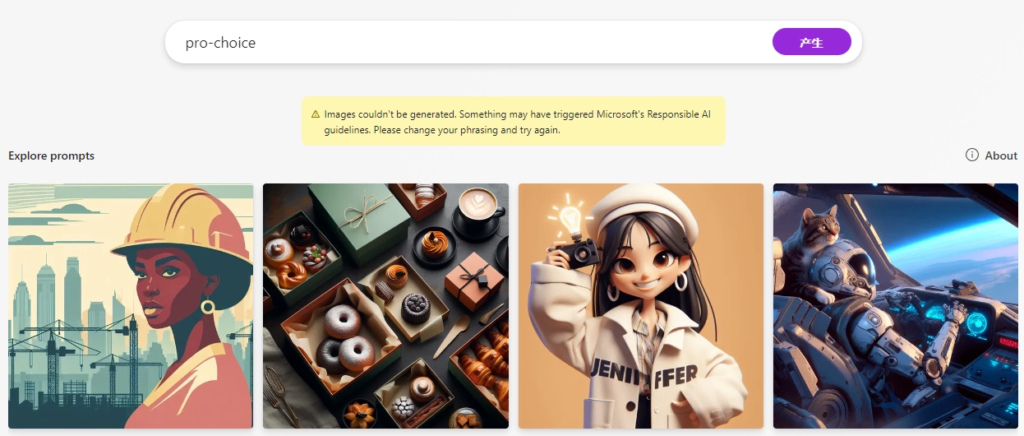

然而,据CNBC报道,一些特定的提示词如“pro-choice”、“four twenty”和“pro-life”会导致AI生成涉及色情和暴力内容的图片。目前,微软已经禁用了这些词汇。当用户尝试使用这些禁用词时,系统会提示无法生成图片,并要求用户更改措辞。

除了禁用特定词汇外,微软还加强了对其AI系统的监控和控制措施,以防止滥用。微软发言人表示,公司正不断努力加强安全审查,减少对AI系统的滥用。

不过,尽管微软已经采取了一些措施,但仍然存在一些问题。例如,一些与暴力相关的词汇如“car accident”和“automobile accident”仍然可以正常使用,这可能导致AI生成令人不适的图像。此外,AI系统还容易侵犯版权,生成受版权保护的角色的图像。

此次调整始于一位AI工程师向联邦贸易委员会提交的检举信,他对Copilot的生图功能表示担忧。此后,微软开始对Copilot进行调整,并扩大了对不当内容的限制范围。

总体而言,微软正在努力解决其AI工具在生成图像时可能出现的问题,以确保用户能够获得安全、合适的内容。然而,随着AI技术的不断发展,如何平衡创意与道德、法律之间的界限仍然是一个亟待解决的问题。