ITCOW牛新网 4月13日消息,继3月下旬成功推出Grok-1.5大语言模型后,马斯克的人工智能公司xAI再次带来创新,近日发布了首个多模态模型Grok-1.5 Vision(简称Grok-1.5V)。这款模型不仅能理解文本,更能处理各类文档、图表、截图及照片中的内容,实现了语言理解与视觉识别的有机结合。

xAI计划近期邀请早期测试者和现有的Grok用户参与测试新模型。公司声称,Grok-1.5V在多学科推理、文档解析、科学图表解读、表格数据处理、屏幕截图内容识别和照片理解等多个方面展示出了强大的能力,其性能足以与当前最前沿的多模态模型相媲美。

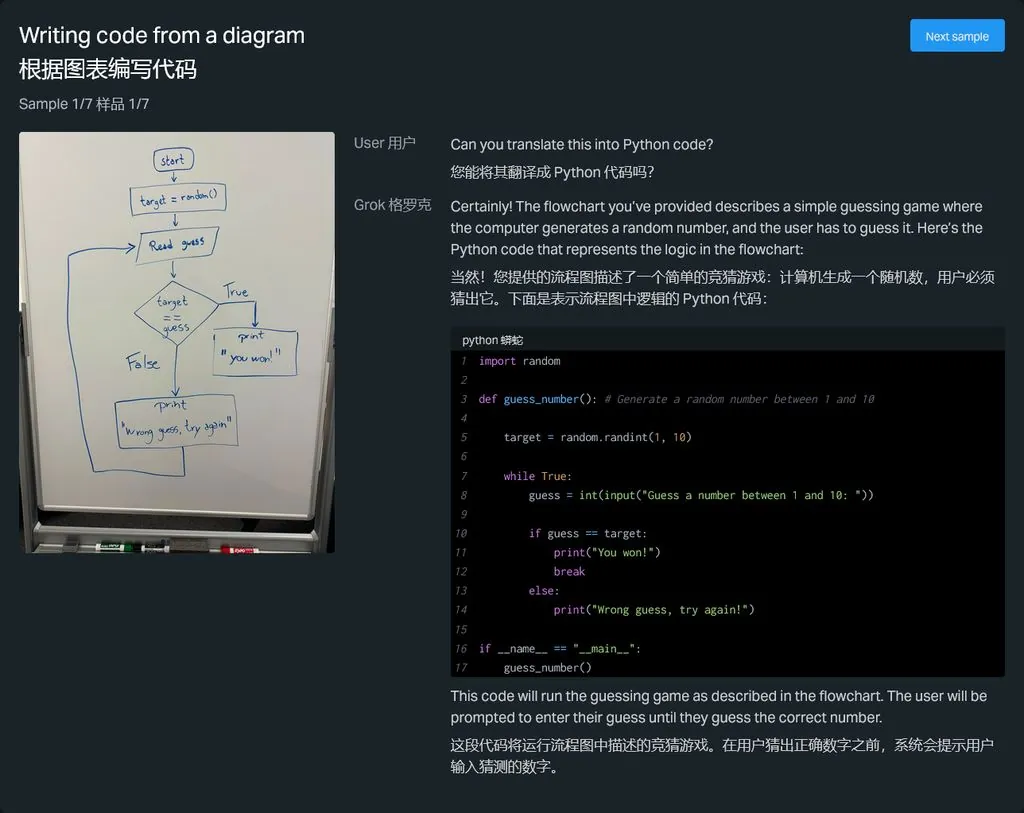

为了直观展示Grok-1.5V的实力,xAI列举了七个具体的应用案例,其中包括将手绘白板上的流程图直接转化为Python代码、根据儿童的稚嫩画作生成富有想象力的睡前故事、解释网络流行语的含义、以及将表格数据快捷地转换为CSV文件格式等。

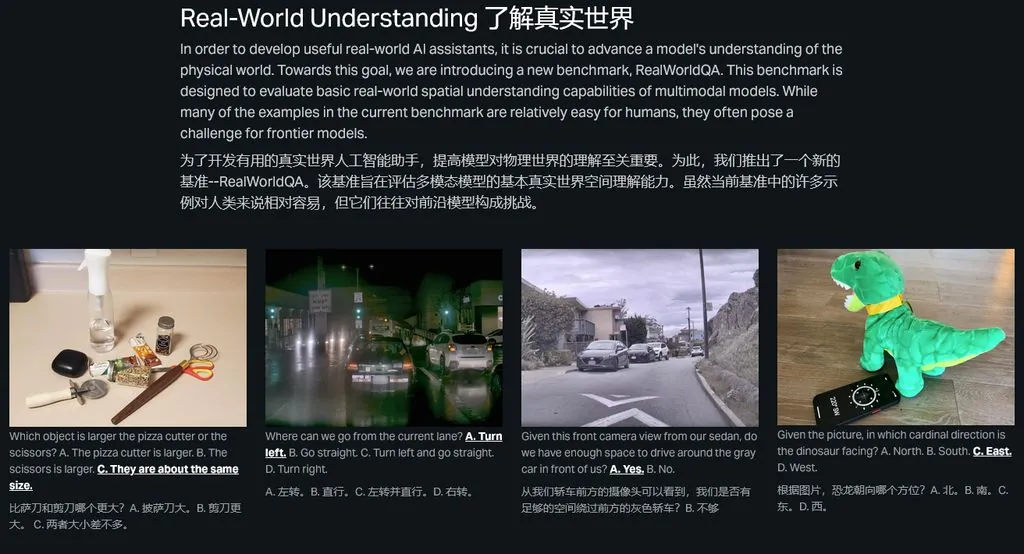

此外,xAI还公开了Grok-1.5V在各项性能测试中的优秀表现。在RealWorldQA基准测试中,Grok-1.5V的表现超越了GPT-4V、Claude 3Sonnet、Claude 3 Opus和Gemini Pro 1.5等当前主流的多模态模型,显示出其强大的理解和推理能力。