ITCOW牛新网 6月7日消息,腾讯混元团队近日携手中山大学和香港科技大学,共同发布了一款名为“Follow-Your-Pose-v2”的图生视频模型。这项创新成果已在arxiv上发表,为视频智能生成领域带来了新的突破。

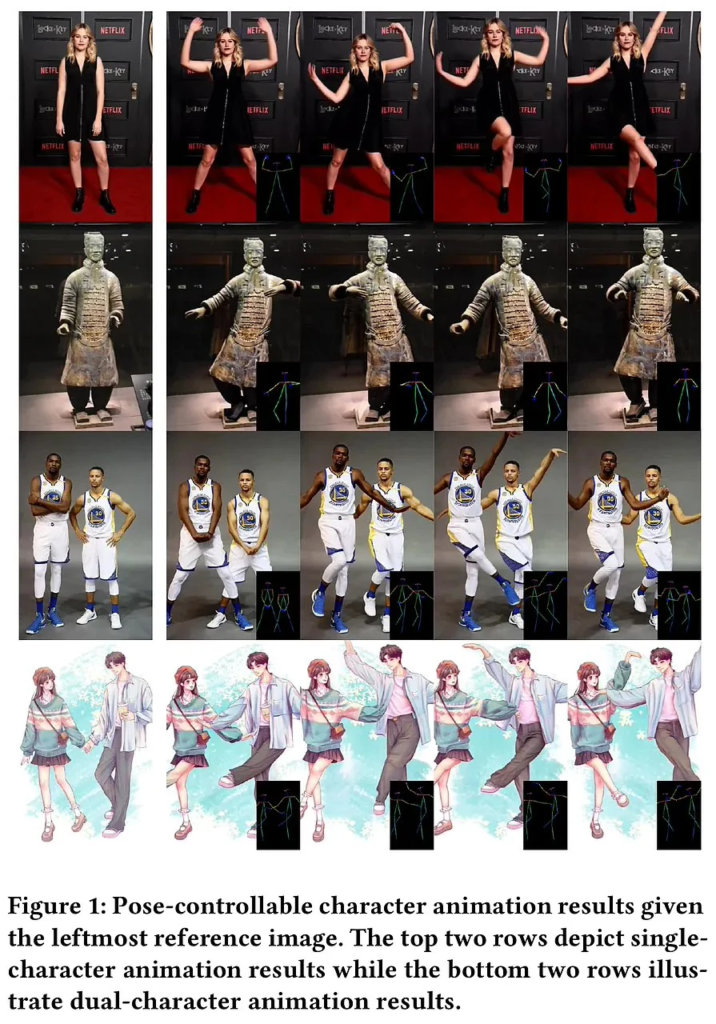

“Follow-Your-Pose-v2”模型以其独特的多条件引导机制,解决了背景稳定性、多人动作生成以及角色外观一致性等挑战。该模型不仅能够处理复杂的背景和多人遮挡场景,还能在推理时减少耗时,支持生成长达10秒的高质量视频。无论输入人物的年龄、服装或背景如何,该模型都能生成高质量的视频。

据ITCOW牛新网了解,与此前的模型相比,“Follow-Your-Pose-v2”在保持高效率的同时,进一步优化了视频生成的质量和灵活性。此外,该模型的泛化能力也得到了显著提升,能够适应各种复杂场景,满足自动广告、社交媒体内容创作等多样化需求。

此外,腾讯此前已经发布了针对其混元文生图开源大模型(混元 DiT)的加速库,大幅提高了推理效率,缩短了生图时间。现在,用户可以通过ComfyUI的图形化界面,更便捷地使用腾讯混元文生图模型的能力。