ITCOW牛新网 4月8日消息,深度求索(DeepSeek)与清华大学联合发布全新AI对齐框架SPCT(自我原则点评调优),通过动态推理优化机制,首次实现中小规模模型逼近万亿参数大模型的性能表现。这项技术突破将大幅降低高性能AI的部署门槛,为产业落地带来新机遇。

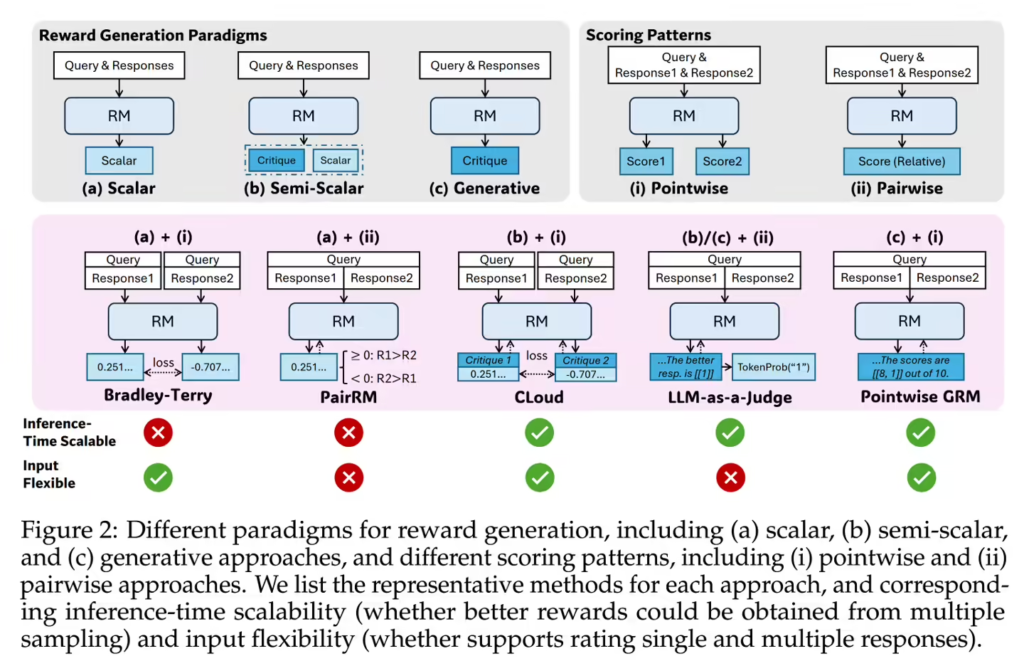

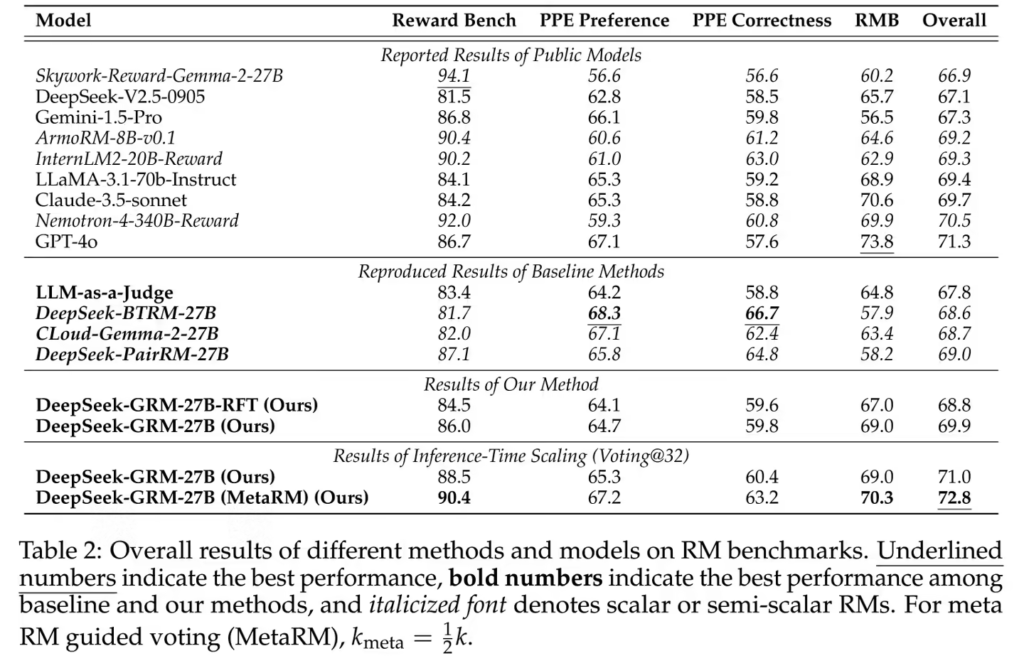

SPCT技术采用四步递归架构:首先生成任务相关原则,随后输出响应内容,再通过内置批判模块过滤低质量结果,最终动态优化原则库。研究团队在4月4日发表的论文中证实,这种”生成-批判-进化”的闭环系统,可使模型在推理阶段持续自我提升,摆脱对海量标注数据的依赖。据ITCOW牛新网了解,该技术已成功应用于270亿参数的DeepSeek-GRM模型,仅需1.2万美元训练成本即达到行业顶尖水平。

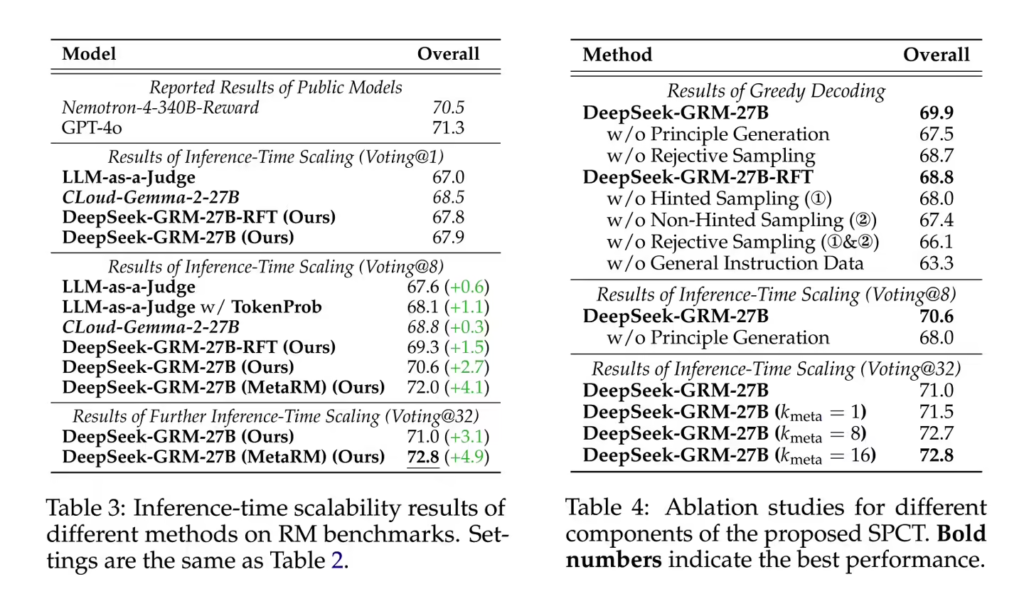

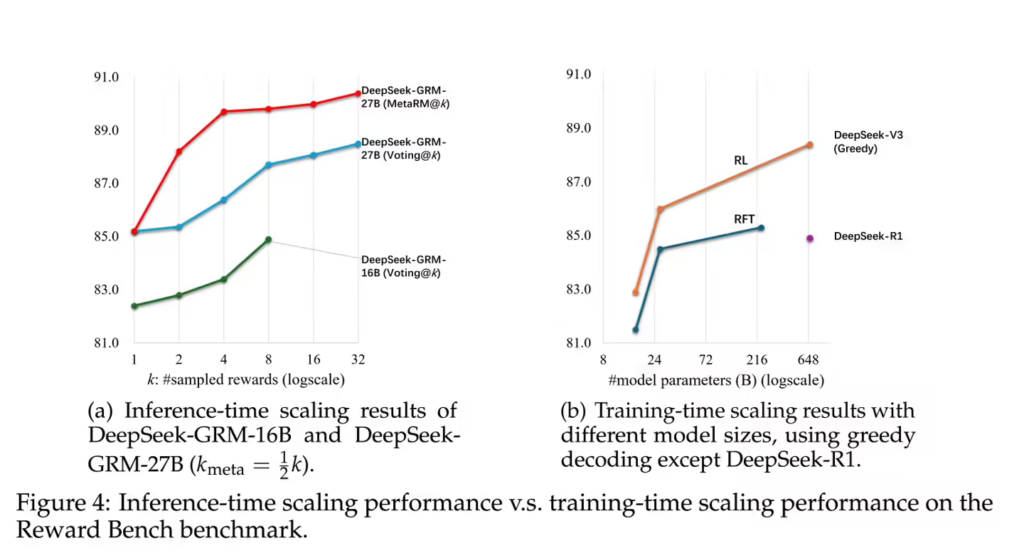

测试数据显示,采用混合专家系统(MoE)的GRM模型,在128k超长上下文窗口支持下,单次查询响应延迟低至1.4秒。通过每查询32次采样的动态优化,其MT-Bench评分达8.35分,性能相当于6710亿参数规模的常规模型。对比显示,该成果以仅525分之一的成本逼近GPT-4o(8.72分),能耗较主流DPO方法降低73%,人工标注需求减少90%。

值得注意的是,SPCT的高效特性使其在实时机器人控制、动态决策系统等场景具有独特优势。随着AI模型规模竞赛进入瓶颈期,这种”轻量化实现高性能”的技术路线,或将成为下一代AI发展的关键方向。