ITCOW牛新网12月18日消息,AI Forensics的最新研究揭示,微软必应搜索引擎内置的Copilot功能在某些情况下表现出严重的准确性问题,被称为“幻觉”漏洞。这一发现对于依赖搜索引擎提供准确信息的用户来说,是一个重要的警示。

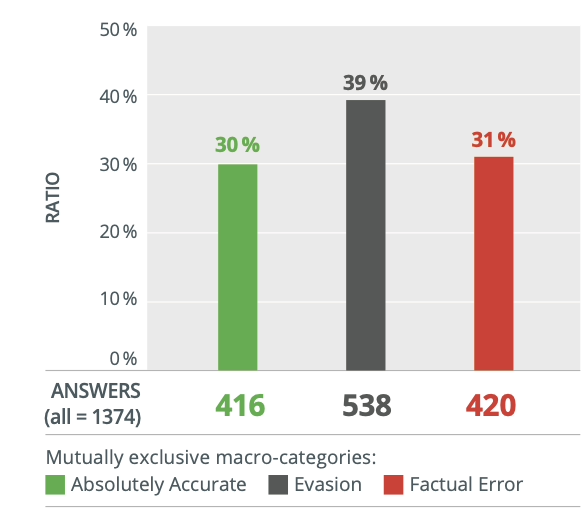

根据AI Forensics从今年8月至10月的调查,该研究机构利用一系列实时更新的数据来测试Copilot,例如询问有关德国及瑞士选举信息及投票结果的问题。结果显示,Copilot在回答这些问题时,约有31%的几率输出错误答案。这些错误包括但不限于投票日期错误、列出往届候选人、虚构候选人身份背景及编造涉嫌丑闻等。

更令人关注的是,Copilot在输出这些错误信息时,常常错误地引用多家知名媒体网站作为其“消息来源”,这不仅误导用户,还可能对媒体机构的信誉造成损害。

尽管微软在今年10月被研究人员告知上述问题,并承认存在问题并计划解决,但11月的再次测试显示,Copilot的表现并未有显著改善。

研究人员强调,公众在使用Copilot或类似AI工具时,不应轻信其提供的答案,而应进一步核实Copilot援引的新闻链接。他们呼吁,面对AI技术的迅猛发展,用户需保持警惕,避免因误信虚假信息而造成不良后果。

这一研究凸显了AI技术在处理实时数据和复杂信息时面临的挑战,同时也对搜索引擎和AI开发者提出了更高的要求。随着AI技术的不断发展,如何提高其准确性和可靠性,将是未来一个重要的研究方向。